Você saberia diferenciar rostos gerados por inteligência artificial (IA) daqueles verdadeiramente humanos? Cientistas da Universidade de Lancaster, na Inglaterra, acreditam que não. De acordo com um comunicado pertinente a um estudo recente da instituição, a tecnologia de IA aplicada na criação de faces de computador está tão avançada que muitos de nós conseguem estabelecer qualquer diferença.

As implicações não param por aí: no mesmo estudo, os pesquisadores concluíram que alguns grupos de pessoas estão considerando rostos gerados por IA mais confiáveis que as faces humanas.

As implicações não param por aí: no mesmo estudo, os pesquisadores concluíram que alguns grupos de pessoas estão considerando rostos gerados por IA mais confiáveis que as faces humanas.

“A nossa avaliação do fotorrealismo de rostos sintetizados pela inteligência artificial indica que motores gráficos já passaram do figurativo ‘vale da estranheza’ e já são capazes de criarem faces que são indistinguíveis — e até mais confiáveis — que rostos verdadeiros”, diz um trecho do comunicado.

“Vale da Estranheza” vem da expressão em inglês “Uncanny Valley”, um termo usado por cientistas para referir-se à sensação de estranheza ou repulsa pela qual nós passamos quando vemos uma figura humanóide – como um robô – se comportar de forma não tão humana. Dizer que os motores gráficos “já passaram” disso é sinônimo de afirmar que a evolução tecnológica já é tanta, que aquilo que nos difere do que é robótico/sintético já não está mais – com o perdão da expressão – “na cara”.

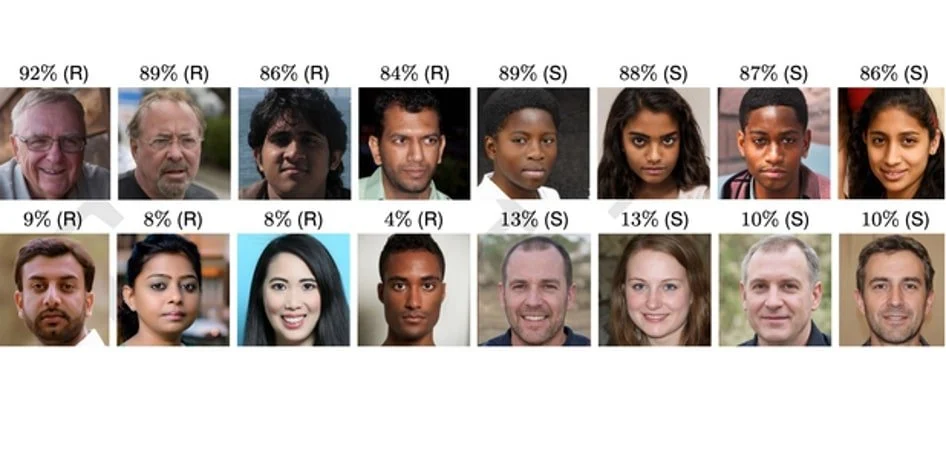

O estudo foi conduzido por um método relativamente simples: os cientistas da universidade reuniram grupos de pessoas e lhes pediram que atribuíssem uma nota de um a sete para o nível de confiabilidade de rostos que lhes eram apresentados – naturalmente, “um” sendo o menos confiável. Os participantes não sabiam se estavam olhando para uma pessoa real ou quais dos rostos haviam sido gerados por uma IA conhecida como “StyleGAN”.

Os resultados indicaram que os rostos sintéticos tiveram 7% mais confiabilidade atribuída do que as faces humanas.

A conclusão disso é a de que a evolução gráfica da inteligência artificial está avançando a níveis considerados perigosos. Os conteúdos conhecidos como “Deepfakes”, por exemplo, dependem quase que exclusivamente da criação de uma impressão fotorrealista de que aquele objeto falso corresponde ao verdadeiro.

E também podemos lembrar do documentário “In The Event of Moon Disaster”, que usou um deepfake para alterar o rumo de um dos eventos mais memoráveis da história: na produção, o ex-presidente americano Richard Nixon, entrega um discurso onde ele lamenta a morte dos astronautas Neil Armstrong, Edwin “Buzz” Aldrin e Michael Collins, da missão Apollo 11, no que seria a primeira visita do homem à Lua.

Evidentemente, trata-se de uma mentira: Armstrong, Aldrin e.Collins foram à Lua, voltaram de lá e viveram plenamente na Terra. Ninguém morreu na viagem, mas o trecho acima impressionou tanto que rendeu um Emmy aos produtores da peça.

“Talvez a consequência mais perniciosa é o fato de que, em um mundo digital onde qualquer imagem ou vídeo pode ser falsificado, a autenticidade de qualquer gravação inconveniente ou de má impressão pode ser questionada”, disse a Dra. Sophie Nightingale, co-autora do estudo.

Claro, existem aplicações muito boas dessa tecnologia: (spoiler adiante) a aparição de Luke Skywalker na série “O Mandaloriano” (Disney+) foi um objeto disso – Mark Hammil, o ator que viveu o personagem em 1977, tem 70 anos, mas o “Luke” da série exibida em 2020 estava incrivelmente jovem. Outro ponto positivo foi um documentário que usou a tecnologia deepfake para recriar digitalmente a voz do falecido chef de cozinha Anthony Bourdain.

“Rostos são uma rica fonte de informação, com uma exposição de meros milissegundos sendo mais que suficiente para trazer referências implícitas sobre traços individuais, como a confiabilidade de uma pessoa”, disse Nightingale. “Nós nos perguntamos se rostos gerados por IA seriam capazes de ativar o mesmo julgamento de confiança. Se não, então a percepção de confiabilidade poderia ajudar a distinguir faces reais de sintéticas”.

O estudo completo será publicado no jornal científico Proceedings of the National Academy of Sciences após revisão, mas pode ser visto em detalhes no Neuroscience News..

FONTE: https://olhardigital.com.br/2022/02/17/ciencia-e-espaco/estudo-indica-que-rostos-gerados-por-ia-estao-ficando-mais-confiaveis-que-humanos/